Parâmetros da Câmera e do Sistema Estereoscópico

- mirella melo

- 17 de fev. de 2024

- 7 min de leitura

Atualizado: 7 de ago. de 2024

A modelagem, ou simplesmente, os parâmetros do sistema, podem ser divididos entre parâmetros intrínsecos, isto é, referente às informações internas do dispositivo, e parâmetros extrínsecos, que envolve notações relevantes relativas aos componentes externos à câmera.

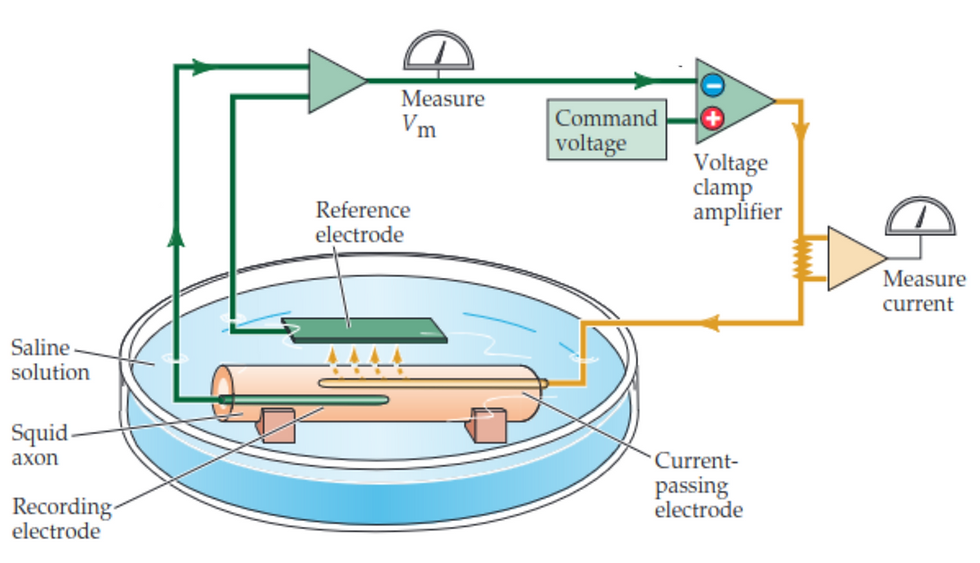

Como ilustrado na Figura 1, são os parâmetros extrínsecos e intrínsecos que permitem a conversão dos diferentes sistemas de coordenados envolvidos: (1) coordenadas de mundo, (2) de câmera e (3) de imagem. As transformações geométricas no âmbito da visão computacional são usualmente baseadas em coordenadas homogêneas, brevemente recapitulado a seguir.

Figura 1: Ilustração dos sistemas de coordenadas de mundo, de câmera e de imagem, e o

respectivo conjunto de parâmetros responsável pela transformação de coordenadas

entre esses sistemas. Fonte: autora [1].

Sistema de Coordenadas Homogêneas

Dado um ponto A(𝑥, 𝑦) em R² no espaço cartesiano, a sua respectiva representação em coordenadas homogêneas é acrescida de uma dimensão, logo, Ã(𝑥, 𝑦, 𝑤) em R³ , onde o elemento adicionado é chamado de peso, e o til (~) é empregado para indicar que o ponto em questão está representado em coordenadas homogêneas. Já a conversão de um ponto Ã(𝑢, 𝑣, 𝑤) no sistema de coordenadas homogêneas para o cartesiano se dá a partir da divisão do peso 𝑤 pelos demais elementos, seguido da diminuição de uma dimensão, neste caso, A(𝑢/𝑤, 𝑣/𝑤).

É importante observar que cada linha em coordenadas homogêneas resulta em um único ponto no espaço cartesiano. Isto é possível de ser observado através de um ponto Ã(𝑘𝑢, 𝑘𝑣, 𝑘𝑤) com 𝑘 assumindo qualquer valor real diferente de zero.

As vantagens de usar esse sistema consistem em (1) cálculos de transformação de coordenadas realizados a partir de operações entre matrizes e equações lineares; e (2) pela possibilidade de representar pontos no infinito, isto é, quando 𝑤 = 0.

Parâmetros Intrínsecos

Os elementos que fazem parte dos parâmetros intrínsecos são aqueles que permitem a mudança do sistema de coordenada (ou frame) da câmera (3D) para o sistema de coordenada do plano da imagem (2D) e vice-versa (Figura 1).

Os parâmetros intrínsecos na Figura 2 são ilustrados a partir de um modelo primitivo de câmera fotográfica, a câmera pinhole. Por conveniência, esse modelo é usualmente representado com o plano de imagem entre o centro de projeção da câmera 𝑂c (onde convergem os raios de luz) e a cena (ilustrado por P). Uma segunda facilidade adotada é a do centro de coordenada do plano da imagem 𝑜 coincidindo com a projeção ortogonal de 𝑂𝑐 no plano.

Figura 2: Ilustração do modelo de câmera pinhole, descrita com o plano da imagem entre o

centro de projeção e a cena, preservando a orientação do ambiente. Adaptada: [2].

Sendo assim, em coordenadas homogêneas, o ponto 𝑃(𝑥, 𝑦, 𝑧, 1) com respeito ao frame da câmera, pode ser relacionado à 𝑝(𝑢, 𝑣, 1) no frame da imagem pela Equação 1, onde

𝑓 representa o comprimento focal da câmera e 𝜆 o fator de escala que permite o ponto 𝑝

transitar por toda a linha 𝑂𝑐𝑃.

Equação 1

No entanto, a representação completa dos parâmetros intrínsecos deve considerar fatores adicionais, ilustrados na Figura 3, são eles: a dimensão física dos pixels indicados por ℎ𝑥 e ℎ𝑦 , geralmente expressado em micrômetro (𝜇𝑚); a origem do sistema de coordenadas da imagem no canto esquerdo superior; o ponto indicado por 𝑜(𝑥𝑜 , 𝑦𝑜) chamado de ponto principal ou central, formado a partir da projeção ortogonal da origem do sistema de câmera 𝑂𝑐 em Π - plano 𝑥𝑦 do sistema bidimensional da imagem; o comprimento focal 𝑓 , isto é, a distância entre 𝑂𝑐 e o ponto principal 𝑜.

Em coordenadas cartesianas, as equações abaixo demonstram como se dá a transformação entre o frame da câmera e da imagem dado um ponto 𝑝(𝑢, 𝑣) qualquer no plano Π.

A partir dos pontos em coordenadas homogêneas, é possível reescrever a Equação 1 considerando, agora, o conjunto completo dos parâmetros intrínsecos. Essa nova representação matricial é ilustrada a seguir.

Parâmetros Extrínsecos

Dado que os parâmetros extrínsecos estão relacionados aos elementos externos da câmera, sua interpretação está intimamente relacionado ao sistema de câmera utilizado mas, em suma, são todos os parâmetros geométricos que permitem a mudança do sistema de coordenadas de mundo para o sistema de coordenadas de câmera e vice-versa (Figura 1).

Na Figura 3, o frame de mundo 𝑂𝑊 e o de câmera 𝑂𝐶 estão destacados. O vetor 𝑇 descreve uma mudança na posição dos centros de coordenadas dos sistemas 𝑂𝑊 e 𝑂𝐶 e a matriz 𝑅 representa a rotação nos eixos correspondentes de cada sistema. Juntos, 𝑇 e 𝑅 constituem os parâmetros extrínsecos, representados pela matriz 𝑀 da Equação 2.

Figura 3: Representação dos parâmetros intrínsecos e extrínsecos de uma câmera. Adaptada: [3].

Equação 2

A relação que garante a transformação de coordenadas de mundo para coordenadas de imagem depende, portanto, das matrizes de parâmetros intrínsecos e extrínsecos, como mostrado na equação a seguir:

Ou de uma forma mais sucinta, a transformação de 𝑝 ̃︀ em coordenadas de imagem para sua respectiva coordenada de mundo 𝑃𝑊 , pode também ser indicada pela equação abaixo, que leva em consideração a matriz de parâmetros intrínsecos 𝐾, e extrínsecos 𝑀 , onde 𝜆 é o fator de escala.

Parâmetros de Distorção

Num cenário ideal, linhas retas do mundo são representadas em linhas retas na imagem. No entanto, devido à curvatura da lente, as imagens resultantes sofrem algum tipo de distorção. Na verdade, existem duas distorções principais da lente: a radial e a tangencial. A primeira é causada pela lente em si, ilustrada na Figura 4, e a segunda resultante do não paralelismo da lente com o plano de imagem, como mostra a Figura 5. A completa modelagem da câmera também deve considerar o cálculo desses valores para que, assim, seja possível transformar as coordenadas da imagem distorcidas, em coordenadas ideais, removendo a distorção.

Figura 4: Tipos de distorções radias: (a) negativa e (b) positiva. Por fim, (c) mostra a lente

ideal sem distorções. Fonte: [4].

Figura 5: distorção tangencial - caracterizada pelo não paralelismo entre o plano da imagem e a lente de convergência. Fonte: autora.

Determinar os parâmetros de distorção nos permite quantificar o quanto determinado ponto na imagem foi afetado pela distorção, permitindo uma engenharia reversa e uma imagem sem distorção (desejada). As Equações 3 à 6 ilustram uma possibilidade de relação entre a imagem desejada (𝑢, 𝑣) e a com distorção (𝑢𝑑, 𝑣𝑑) radial e tangencial. Os elementos 𝑟𝑛(𝑛=1,2,3) denotam os coeficientes de distorção radial, e 𝑡𝑛(𝑛=1,2) os coeficientes tangenciais. 𝑑 refere-se à distância radial em pixels (equação 8) de um ponto (𝑢, 𝑣) em relação ao ponto principal (𝑢𝑑, 𝑣𝑑). Observe pelas Equações 3 e 4 que, à medida que 𝑑 aumenta, a distorção aumenta de forma não linear.

Dessa forma, os elementos de distorção fazem parte do conjunto de parâmetros intrínsecos da câmera. Seus valores, assim como dos parâmetros extrínsecos, são calculados a partir da etapa conhecida como calibração da câmera.

Calibração da Câmera

A etapa conhecida como calibração da câmera é realizada a fim de calcular os parâmetros intrínsecos e extrínsecos da câmera. Inicialmente, é preciso obter imagens de um padrão previamente conhecido. Assim, um algoritmo de processamento de imagem pode facilmente reconhecê-lo e, a partir da correspondência dos pontos 3D da cena com os 2D do plano, estimar os parâmetros.

Amplamente utilizado, tem-se a calibração com um tabuleiro de xadrez [5]. O método detecta os cantos em múltiplas visualizações e estima os parâmetros que minimiza o erro entre as coordenadas do espaço e suas respectivas projeções nos planos de imagem. O erro mínimo é calculado a partir do algoritmo de Levenberg-Marquardt [6], que depende de uma primeira estimativa dos parâmetros. A Figura 6 ilustra apenas três pares de imagem do tabuleiro visto de diferentes perspectivas.

Figura 6: Processo de calibração da câmera a partir de um padrão planar, neste caso, o

tabuleiro de xadrez. Fonte: autora.

A calibração por padrão planar (2D) é amplamente empregado a partir do tabuleiro de xadrez, mas há também a utilização de padrões 1D [7] e até adimensional, com o uso de sensor infra-vermelho [8]. Quando há pouco controle sobre a configuração de imagem (por exemplo, com uma única imagem da cena), a calibração pode ser realizada através de métodos baseados em aprendizado profundo [9].

Diversas técnicas propostas e disponíveis em código aberto, e.g biblioteca do OpenCV, juntamente com sua respectiva referência para maiores detalhamentos, podem ser acessadas em [10]. Uma visão mais detalhada sobre esse tópico, das técnicas e da matemática envolvida podem ser encontradas em [2].

Referências

[1] MELO, Mirella Santos Pessoa de. Mapeamento de região navegável a partir de um sistema SLAM e segmentação de imagem. 2021. Dissertação de Mestrado. Universidade Federal de Pernambuco.

[2] HARTLEY, R.; ZISSERMAN, A. Multiple View Geometry in Computer Vision. 2. ed. [S.l.]:

Cambridge University Press, 2004.

[3] CYGANEK, B.; SIEBERT, J. P. An introduction to 3D computer vision techniques and

algorithms. [S.l.]: John Wiley & Sons, 2011.

[4] MATHWORKS. What Is Camera Calibration? 2016. <https://de.mathworks.com/help/

vision/ug/camera-calibration.html>. [Online; Acessado 20-Setembro-2021].

[5] ZHANG, Z. A flexible new technique for camera calibration. IEEE Transactions on pattern

analysis and machine intelligence, IEEE, v. 22, n. 11, p. 1330–1334, 2000.

[6] MORÉ, J. J. The Levenberg-Marquardt algorithm: implementation and theory. In: Numerical analysis. [S.l.]: Springer, 1978. p. 105–116.

[7] BORGHESE, N. A.; CERVERI, P. Calibrating a video camera pair with a rigid bar. Pattern

Recognition, Elsevier, v. 33, n. 1, p. 81–95, 2000.

[8] SVOBODA, T.; MARTINEC, D.; PAJDLA, T. A convenient multicamera self-calibration for

virtual environments. Presence: Teleoperators & virtual environments, MIT Press One Rogers

Street, Cambridge, MA 02142-1209, USA journals-info . . . , v. 14, n. 4, p. 407–422, 2005.

[9] LOPEZ, M.; MARI, R.; GARGALLO, P.; KUANG, Y.; GONZALEZ-JIMENEZ, J.; HARO, G.

Deep single image camera calibration with radial distortion. In: Proceedings of the IEEE/CVF

Conference on Computer Vision and Pattern Recognition. [S.l.: s.n.], 2019. p. 11817–11825.

[10] BOUGUET, J.-Y. A few links related to camera calibration. 2015. <http://www.vision.

caltech.edu/bouguetj/calib_doc/htmls/links.html>. [Online; Acessado 20-Setembro-2021].

Comentários